Dati migliori, modelli migliori, risultati reali

I tuoi modelli AI sono buoni quanto i dati su cui li alleni.

Garbage in, garbage out non è un cliché

La ragione principale per cui i progetti AI falliscono non è l’algoritmo: sono i dati. Etichette inconsistenti, bias non rilevati, class imbalance, casi limite non gestiti. Ogni difetto nel dataset si amplifica nel modello. Per il fine-tuning di LLM, servono migliaia di esempi eccellenti, non milioni di esempi mediocri.

Pipeline di annotazione con quality assurance, inter-annotator agreement misurato, active learning per ridurre lo sforzo, e data versioning per tracciare ogni evoluzione del dataset.

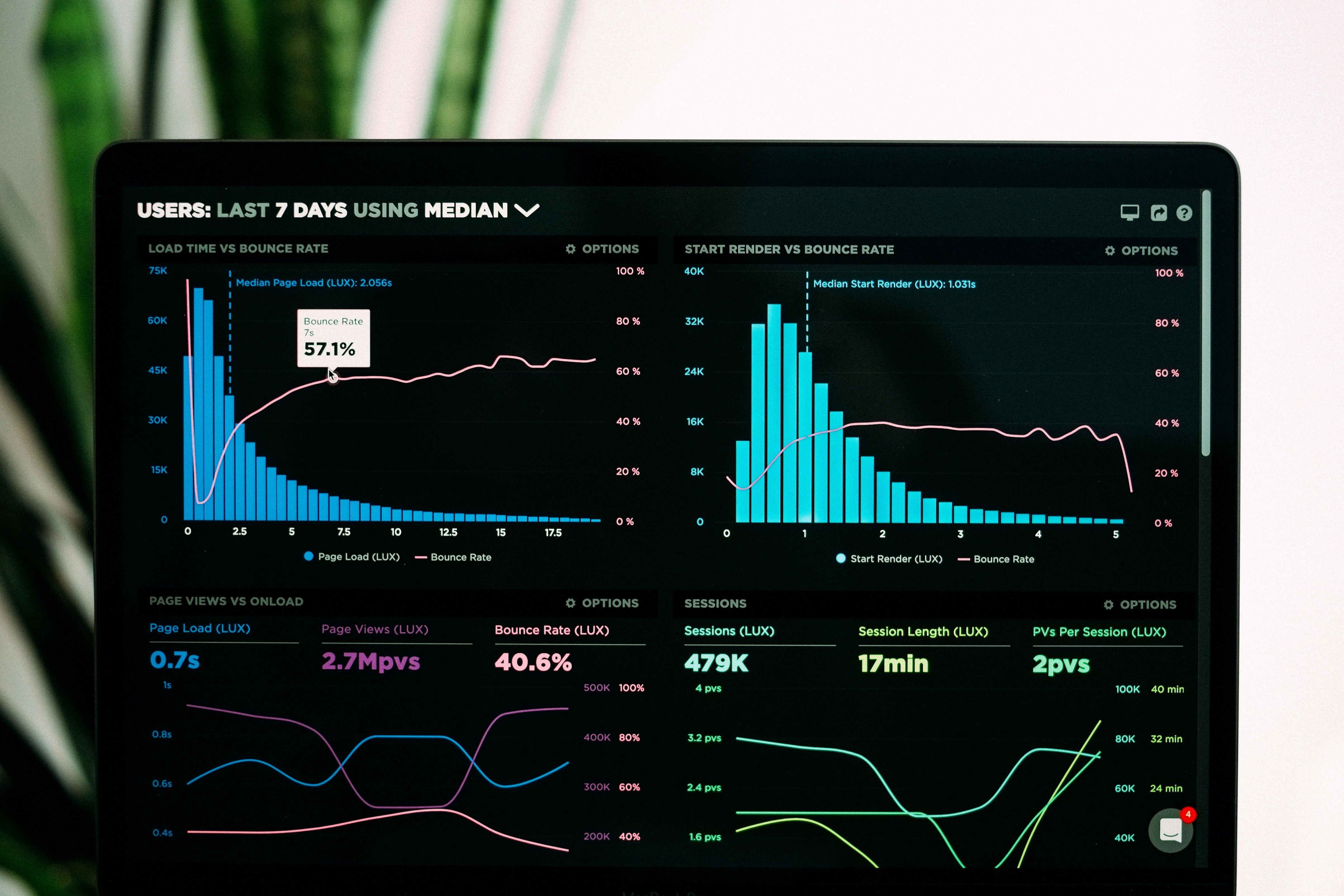

Risultati concreti

+15-30% accuratezza modello con dataset curati vs dataset non controllati

-50% effort di annotazione con active learning e pre-annotazione automatica

0.85+ inter-annotator agreement raggiunto con guidelines calibrate

Data versioning completo per riprodurre qualsiasi training passato

Bias detection prima che gli squilibri si propaghino al modello

Use case

Active Learning: migliorare l'accuratezza dei modelli su clausole contrattuali

In molte aziende legaltech o studi legali che adottano modelli NLP per classificare clausole contrattuali, il problema non è la quantità di dati: è la qualità delle etichette. Un inter-annotator agreement basso indica che gli annotatori interpretano diversamente le stesse clausole, e il modello assorbe questa ambiguità come segnale di training. Guidelines ridefinite, sessioni di calibrazione e active learning (tecnica che seleziona automaticamente gli esempi più informativi da etichettare, riducendo lo sforzo complessivo) permettono di migliorare l'agreement e di conseguenza l'accuratezza del modello sulle clausole critiche, riducendo drasticamente lo sforzo di annotazione necessario a ogni iterazione.

Segmentation Mask + Data Augmentation: aumentare la precision nel controllo qualità visivo

Un sistema di visione artificiale per il controllo qualità in linea di produzione richiede dataset annotati con precisione per ogni categoria di difetto rilevante. Per molte aziende agrifood o manifatturiere, i difetti rari, che sono spesso i più critici, sono sottorappresentati nel dataset reale e producono modelli con recall insufficiente. Un processo strutturato di annotazione con segmentation mask (delimitazione pixel-precise delle aree di difetto) su migliaia di immagini, combinato con data augmentation per le categorie rare, permette di aumentare la precision e il recall del modello sui difetti critici, riducendo i falsi negativi che sfuggono al controllo automatico.

Fine-Tuning + Red Teaming: aumentare il tasso di approvazione di contenuti generati da LLM

Molte agenzie e aziende che adottano modelli linguistici (LLM) per generare descrizioni (di immobili, prodotti, servizi) ottengono un tasso di approvazione umana basso sul modello base non adattato, perché il modello non conosce il tono, le convenzioni e i vincoli del contesto specifico. Un processo di fine-tuning su descrizioni curate e coppie istruzione-output create ad hoc, combinato con red teaming per identificare e correggere gli output problematici, permette di aumentare drasticamente il tasso di approvazione e di ridurre il lavoro di revisione manuale, rendendo il modello uno strumento produttivo invece di una fonte di relavoro.

Tecnologie chiave

Hai un progetto AI che ha bisogno di dati affidabili?

Parliamo del tuo caso d'uso e definiamo la strategia.