Data Curation & Labeling

Dai ai tuoi modelli AI dati di qualità, non rumore.

Il problema in breve

I modelli di machine learning sono buoni quanto i dati su cui vengono addestrati. “Garbage in, garbage out” non è un cliché: è la ragione principale per cui i progetti AI falliscono. Dataset incompleti, etichette inconsistenti, bias nei dati di training, mancanza di rappresentatività, ogni difetto nel dataset si amplifica nel modello finale. La Data Curation & Labeling è il lavoro fondamentale, spesso sottovalutato, che determina se un progetto AI produrrà risultati affidabili o decisioni ingannevoli.

La sfida

La creazione di dataset di alta qualità per il machine learning è un processo che richiede più rigore di quanto appaia. L’etichettatura (labeling) sembra semplice, classificare immagini, annotare testi, taggare entità, ma nasconde insidie significative: ambiguità nelle linee guida di annotazione, inconsistenza tra annotatori diversi, gestione dei casi limite, class imbalance.

Per i progetti di fine-tuning di Large Language Models, la sfida si sposta sulla curatela dei dati di training. Non servono milioni di esempi: servono migliaia di esempi eccellenti. La qualità degli instruction-response pair, la diversità degli scenari coperti, la coerenza del tono e dello stile, ogni aspetto influenza il comportamento del modello risultante. Dataset curati male producono modelli che allucinano di più, seguono le istruzioni peggio, o hanno bias indesiderati.

La gestione del ciclo di vita del dato aggiunge complessità. I dati cambiano, i requisiti del modello evolvono, nuove classi vengono aggiunte. Senza un sistema di data versioning e un processo di quality assurance continuo, la qualità del dataset degrada nel tempo. L’active learning, l’uso del modello stesso per identificare i campioni più informativi da etichettare, può ridurre drasticamente lo sforzo di annotazione, ma richiede un’infrastruttura specifica e competenze di implementazione.

La soluzione

Annotation Guidelines & Calibrazione

L’approccio parte dalla definizione delle annotation guidelines: documenti dettagliati che specificano come gestire ogni caso, inclusi i casi ambigui. Si conducono sessioni di calibrazione con gli annotatori per allineare l’interpretazione e si misurano metriche di inter-annotator agreement (Cohen’s kappa, Fleiss’ kappa) per quantificare la consistenza.

Pipeline di Annotazione Specializzata

Per progetti di NLP e document AI, si implementano pipeline di annotazione specializzate: Named Entity Recognition, relation extraction, document classification, sentiment analysis. Per computer vision: bounding box, segmentation mask, keypoint annotation. Per il fine-tuning di LLM: creazione di instruction-response dataset con criteri di qualità espliciti, red teaming per identificare output problematici, e iterazioni di refinement basate sulle performance del modello.

Infrastruttura, Quality Assurance & Active Learning

L’infrastruttura di supporto include: piattaforma di labeling con workflow di review multi-livello, data versioning per tracciare ogni modifica al dataset, pipeline di quality assurance automatizzata con controlli statistici (distribuzione classi, outlier detection, consistency check), e processi di active learning per ottimizzare lo sforzo di annotazione. Il deliverable è un dataset documentato, versionato, con metriche di qualità trasparenti e pronto per il training.

Tecnologie chiave

Feature Engineering

Trasformazione dei dati grezzi in feature utilizzabili per il training.

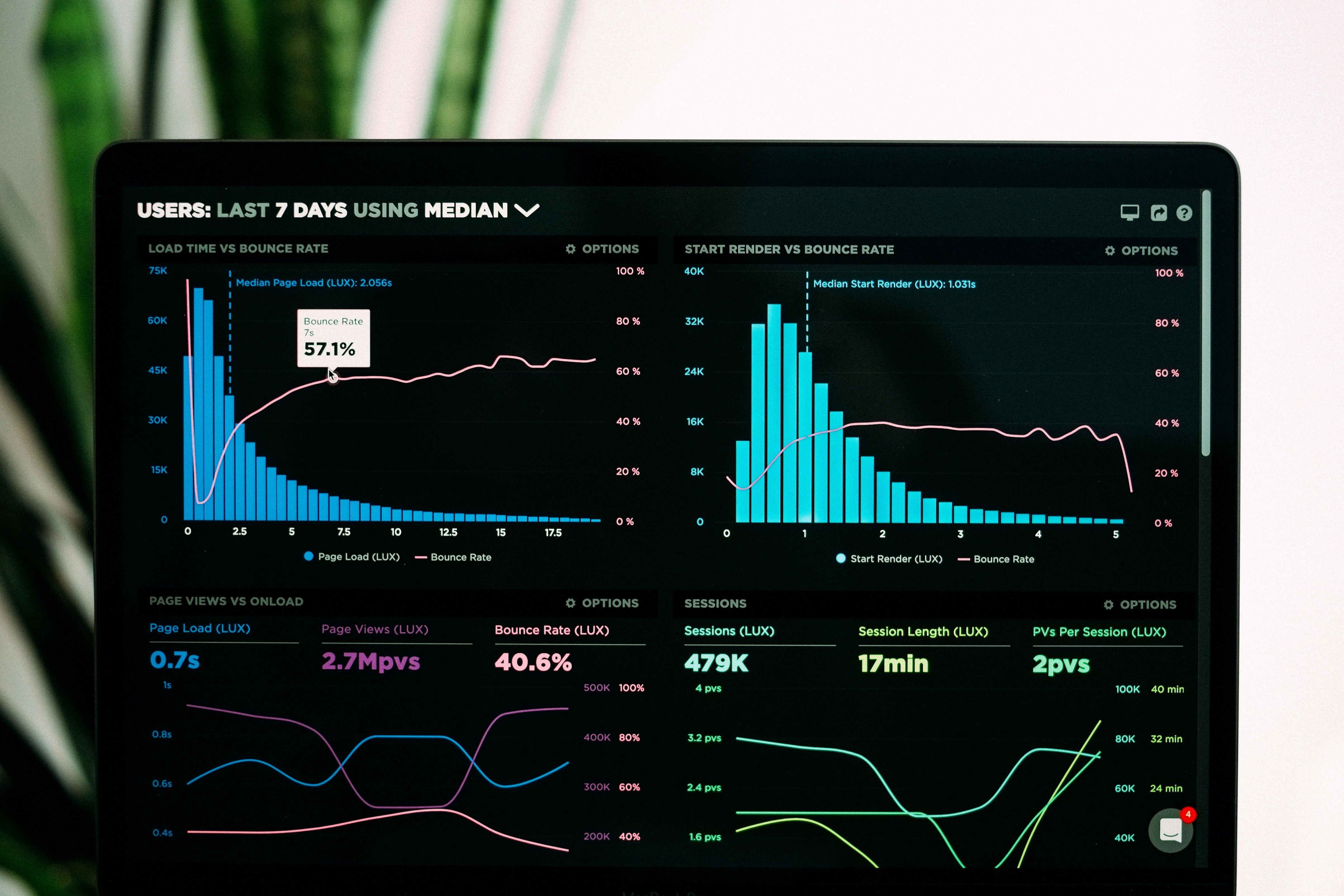

ApprofondisciRisultati e benefici

+15-30% accuratezza del modello con dataset curati rispetto a dataset non controllati

-40-60% dell’effort di annotazione con active learning e pre-annotazione automatica

Inter-annotator agreement superiore a 0.85 (Cohen’s kappa) con guidelines calibrate

Data versioning completo che permette di riprodurre qualsiasi training passato

-50% del tempo di iterazione modello grazie a dataset con metriche di qualità integrate

Bias detection che identifica squilibri nel dataset prima che si propaghino al modello

Dataset riutilizzabili e incrementali per modelli successivi, evitando di ripartire da zero

Use case

Startup legaltech, annotazione contratti per NLP

Una startup legaltech con 3M ARR stava sviluppando un sistema di estrazione automatica di clausole contrattuali. Il dataset iniziale, 500 contratti annotati internamente da avvocati junior, aveva un inter-annotator agreement di 0.52, rendendo il modello inaffidabile su clausole ambigue. Si sono ridefinite le guidelines con 45 regole di annotazione specifiche per i casi limite, condotte 3 sessioni di calibrazione, e implementata una pipeline con doppia annotazione e adjudication. L’agreement è salito a 0.89, l’accuratezza del modello dal 67% all’86% sulle clausole critiche, e lo sforzo di annotazione per contratti futuri si è ridotto del 55% grazie all’active learning.

Azienda agrifood, classificazione qualità prodotti

Un’azienda di trasformazione alimentare con 25M di fatturato voleva automatizzare la classificazione qualitativa dei prodotti in linea di produzione. Servivano dataset di immagini annotate con bounding box per 12 categorie di difetti. La sfida: le immagini erano acquisite in condizioni variabili (illuminazione, posizione, background) e i difetti più rari rappresentavano meno del 2% del dataset. Si è implementata una pipeline di data augmentation per i difetti rari, annotazione con segmentation mask per precisione sub-pixel, e un processo di review con il team di qualità. Il dataset finale, 15K immagini annotate, ha permesso un modello con precision del 94% e recall del 91% sui difetti critici.

Agenzia immobiliare, fine-tuning LLM per descrizioni

Una rete di agenzie immobiliari con 18M di fatturato voleva generare automaticamente descrizioni degli immobili in stile professionale. Il fine-tuning richiedeva un dataset di coppie (caratteristiche immobile, descrizione ideale). Si sono curate 2000 descrizioni esistenti, scartando quelle di bassa qualità, normalizzando lo stile, e creando 800 nuove coppie con il team editoriale. Il processo ha incluso red teaming per identificare output problematici (affermazioni false, linguaggio discriminatorio, omissioni legali). Il modello fine-tuned ha raggiunto un approval rate del 92% dai commerciali, rispetto al 45% del modello base non fine-tuned.

Hai un progetto AI che richiede dati di training affidabili?

Raccontaci il caso d'uso e ti aiuteremo a definire la strategia di data curation più efficace.